Руководство по включению G-sync на мониторе FreeSync

Что такое синхронизация в мониторе?

Видеокарты обычно неспособны поддерживать постоянную частоту смены кадров – в их работе высокие пики производительности могут чередоваться с внезапными падениями. Частота смены кадров зависит от того изображения, которое выводит видеокарта. Например, спокойные сцены без особой активности гораздо менее требовательны к производительности, чем эпические схватки с «боссами», полные спецэффектов.

Когда частота смены кадров видеокарты не совпадает с частотой смены кадров монитора, возникают определенные проблемы с отображением: разрывы, задержки или наложения, пока монитор ожидает новые данные или пытается отобразить два разных кадра как один.

Технология обеспечения устойчивого качества изображения называется FreeSync и требует наличия видеокарты AMD и монитора FreeSync. В то же время существует и технология G-Sync от NVIDIA, которая подразумевает наличие видеокарты NVIDIA и монитора с поддержкой G-Sync.

Совместимость с G-Sync

Видеокарты нового поколения от NVIDIA могут использовать функции G-Sync на некоторых мониторах FreeSync от AOC. NVIDIA анонсировала список сертифицированных мониторов AOC, которые также совместимы с G-Sync. Если ваш монитор AOC в этом списке отсутствует, вы все равно можете включить G-Sync и протестировать его производительность.*

NVIDIA анонсировала список сертифицированных мониторов AOC, которые также совместимы с G-Sync. Если ваш монитор AOC в этом списке отсутствует, вы все равно можете включить G-Sync и протестировать его производительность.*

Как включить G-sync на вашем мониторе FreeSync

— Обновите драйвер NVIDIA хотя бы до версии 417.71 (более ранние версии работать не будут).

— В панели управления монитора включите переменную частоту обновления.

После выполнения всех указанных выше шагов, G-Sync включится автоматически. В противном случае, вы можете включить эту функцию вручную, предприняв еще некоторые действия.

— Откройте панель управления Nvidia в правой нижней части рабочего стола Windows.

— Выберите «Display» (дисплей) и нажмите «Set up G-SYNC» (настроить G-SYNC).

— Выберите ваш монитор в «Enable settings for the selected display model» (включить настройки для выбранной модели дисплея).

— Примените настройки.

Если вышеописанный метод не сработал, возможно, вам придется выполнить еще несколько действий.

— Перейдите в «Manage 3D Settings» (управление настройками 3D), нажмите «Global» (общие), прокрутите вниз до «Monitor Technology» (технологии монитора), выберите «G-SYNC Compatible» (совместимость с G-SYNC), затем нажмите «Apply» (применить).

Теперь вы успешно включили G-Sync на вашем мониторе AOC FreeSync. Качество изображения всегда будет идеальным и вы сможете получать максимальное удовольствие от игрового процесса без раздражающих искажений.

Качество изображения всегда будет идеальным и вы сможете получать максимальное удовольствие от игрового процесса без раздражающих искажений.

* Полный список видеокарт, поддерживающих мониторы FreeSync, а также мониторы, совместимые с G-Sync, см. на веб-сайте NVIDIA.

Что такое G-Sync, FreeSync, V-Sync и HDMI VRR?

Всех ПК-геймеров планеты Земля объединяет одна проблема — вертикальные разрывы изображения. И вроде бы есть куча технологий которые решают эту проблему:

- V-Sync,

- G-Sync,

- FreeSync

- А в HDMI 2.1 недавно добавили VRR.

Но легче от этого не становится. Только больше путаешься. Чем все эти технологии отличаются? Какую выбрать видеокарту и монитор? И будет ли это всё работать на телевизоре?

Давайте сегодня раз и навсегда разберемся в технологиях адаптивной синхронизации изображения.

Для тех кто не в курсе. А в чём собственно проблема?

Чтобы изображение появилось на экране, должно произойти, как минимум, две вещи:

- графический процессор должен подготовить кадр и передать его на монитор,

- ваш монитор должен показать этот кадр.

Вроде бы всё просто! Но тут кроется небольшой конфликт. Монитор работает по строгому расписанию. Нужно обновлять изображение на экране через равные промежутки времени, строго определённое количество раз в секунду. Этот параметр называется частотой обновления и измеряется он в герцах.

Обычные мониторы работают на частоте 60 Гц, то есть способны выводить 60 кадров в секунду, а игровые на 144 Гц и выше.

А вот графический процессор живет в совершенно ином мире. В играх постоянно всё меняется: колышется листва, журчит ручеёк, враги выпрыгивают из-за угла.

Иными словами, у монитора частота кадров постоянная, а у видеокарты переменная.

Вот и выходит, что за один цикл обновления монитора видеокарта может подготовить больше одного кадра или меньше.

Из-за этого мало того что страдает плавность картинки, так еще и появляются артефакты в виде вертикальных разрывов изображения. Кстати, при просмотре фильмов тоже могут появляться такие артефакты, потому что кино снимают в 24 к/с.

V-Sync

Очевидно проблема требовала решения, и еще на заре компьютерных игр оно появилось! Название у этого решения — вертикальная синхронизация или V-Sync. Наверняка вы встречали такую опцию как в настройках видеокарты, так и в играх.

Работает эта штука достаточно топорно. Фактически она просто принуждает видеокарту выводить кадры с частотой кратной частоте обновления экрана. Например, если у вас монитор 60 Гц, то максимальное количество кадров в секунду тоже будет 60, даже если ваша видеокарта способна на большее. И в общем-то часто такое ограничение вполне уместно, если у видеокарты хватает мощи и нет просадок ниже 60 к/с, но если они есть — начинаются проблемы.

И в общем-то часто такое ограничение вполне уместно, если у видеокарты хватает мощи и нет просадок ниже 60 к/с, но если они есть — начинаются проблемы.

При включенной вертикальной синхронизации, следующее кратное значение — это 30 к/с. Поэтому даже если ваш фреймрейт просел фактически всего на пару кадров, вы всё равно увидите падение до 30 к/с. Такой перепад мало того, что большой и очень визуально ощутимый, так ещё и будет происходить с небольшим лагом. Поэтому если стабильного FPS в 60 к/с или 30 не достичь, то включать V-Sync вообще нет никакого смысла.

Справедливости ради, чем выше герцовка монитора, тем больше мы имеем кратных значений, на которых может работать синхронизация. Поэтому на игровых мониторах V-Sync работает куда лучше.

Но история с кратными значениями — не самая главная проблема технологии. Есть другой не очевидный недостаток: вертикальная синхронизация — увеличивает задержку ввода, то есть Input Lag.

Игра медленнее реагирует на ваши действия, всё происходит с задержками и как-то плывёт в молоке, поэтому прицелиться становится гораздо сложнее. Почему так происходит?

Почему так происходит?

Это интересно, смотрите! Каждый кадр рассчитывается и выводится на экран через один и тот же конвейер. Упростим его до трёх этапов.

- Каждое ваше действие, например щелчок мышки надо как-то интерпретировать и обновить состояние игры. За это отвечает центральный процессор (синяя полоса на картинке). Центральный процессор подготавливает кадры для графического процессора и помещает их в очередь рендеринга графического процессора.

- Затем графический процессор (зелёная полоса) берет эти подготовленные кадры из очереди и рендерит их.

- Только потом эти кадры выводятся на дисплей (серая полосочка на картинке).

Ну и в чём проблема, спросите вы? Дело в том, что ЦП не берется за подготовку следующего кадра, пока предыдущий не будет выведен на экран. Поэтому ограничивая количество выводимых кадров в угоду синхронизации с дисплеем, мы фактически увеличиваем задержки с которыми обновляется состояние игры! И если в каких-то простеньких играх типа пасьянса такие вещи допустимы, то в соревновательных играх вертикальная синхронизация может стать серьёзной помехой.

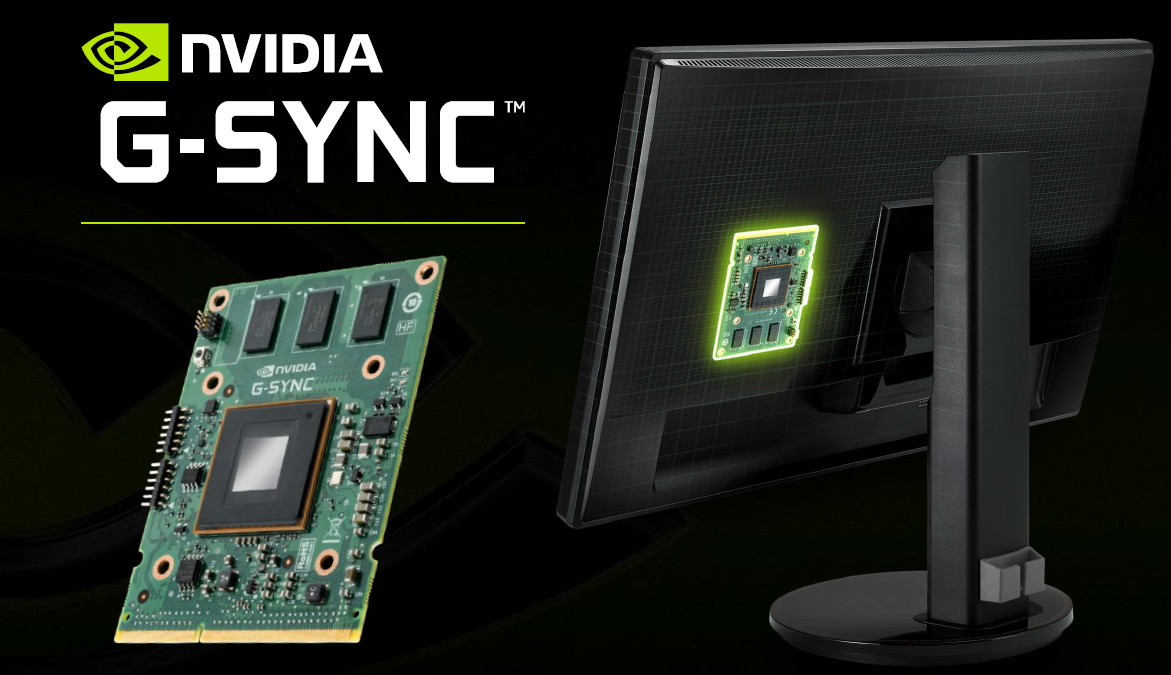

G-Sync

Но переживать не стоит, так как решение появилось еще в 2013 году. Именно тогда компания NVIDIA представила свою технологию адаптивной синхронизации — G-Sync. В отличие от старой технологии, G-Sync позволяет подстраивать не видеокарту под частоту обновления монитора, а наоборот заставляет монитор менять свою частоту под видеокарту!

Представляете? Так тоже можно было!

В результате мы получаем потрясающе плавную картинку без вертикальных разрывов и задержки ввода! Просто сказка! G-Sync также работает в огромном диапазоне частот. Изначально это было от 30 до 144 Гц, а сейчас уже есть поддержка до 360 Гц и может даже выше, тут скорее всё зависит от монитора.

А если фреймрейт падает ниже 60 Гц G-Sync умеет дублировать пропущенные кадры.

Получаются сплошные плюсы и проблема решена еще в 2013 году? Так почему же мы до сих пор об этом говорим?

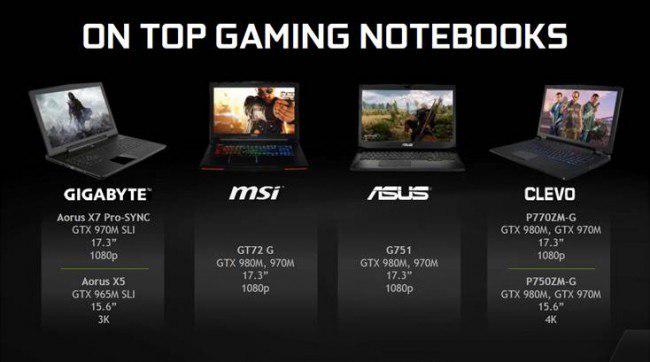

Ну как сказать. Во-первых, эта технология закрытая, соответственно, G-Sync работает только с карточками NVIDIA, но это пол беды.

Все волшебные функции G-Sync стали возможны благодаря специальному чипу, который необходимо встроить в монитор. Естественно, эти чипы производит тоже NVIDIA и стоят они недешево. Поэтому мониторы с поддержкой G-sync в среднем стоят на 250-300$ дороже и таких моделей очень мало. То есть получилась классная, и для 2013 года революционная технология, но не универсальная и дорогая.

VESA Adaptive Sync

Поэтому уже спустя год, в 2014, Ассоциация стандартизации Video Electronics Standards Association или VESA представила открытую технологию Adaptive Sync, которая умеет, в принципе, всё то же самое, что и G-Sync, но без дорогостоящих чипов и работает на частотах от 9 до 240 Гц! Неплохо да?

Но для внедрения технологии нужно, чтобы её поддержку внедрили в прошивку и драйвер монитора, драйвер видеокарты, операционной системы и в игры!

А также необходимо наличие DisplayPort версии не ниже 1.2a, так как технология стала частью именно Display Port. Как видите, чтобы технология взлетела, нужно было проделать много работы. И этой работой занималась компания AMD.

Как видите, чтобы технология взлетела, нужно было проделать много работы. И этой работой занималась компания AMD.

AMD FreeSync

В 2015 году AMD внедрили Adaptive Sync в драйвера своих видеокарт и назвали технологию FreeSync. Реализация от AMD быстро получила очень широкое распространение. Добавить поддержку FreeSync в монитор оказалось настолько дешево, что сейчас сложнее найти игровой монитор без этой фичи, чем с ней.

Но AMD не остановились на просто внедрении стандарта от VESA. Также они добавили поддержку HDMI, начиная с версии 1.4. А в 2017 выпустили FreeSync 2, в который добавилась поддержка HDR и компенсацию низкой частоты кадров, как в G-SYNC.

Кстати, чуть позже, FreeSync 2 переименовали в в более элитное FreeSync Premium Pro, а обычный FreeSync для мониторов с частотой 120 Гц и выше стали называть FreeSync Premium. Хотя такие маркетинговые финты я не одобряю, но в остальном сплошной респект AMD за популяризацию стандарта.

Кстати, NVIDIA также в 2017 году добавила поддержку HDR и назвала это всё G-Sync Ultimate.

И вроде бы всё классно, в команде у красных и у зеленых есть по своей шикарной технологии. Но что делать, если у тебя видеокарта от NVIDIA, ты хочешь нормальную поддержку G-Sync, но покупать дорогущий монитор с этой технологией совсем не хочется? Или наоборот — не покупать же Radeon только потому что у тебя монитор с FreeSync?

До недавнего времени выбора не было никакого. Хочешь подешевле и побольше выбор мониторов — покупай Radeon. В другом случае, придется раскошелиться.

G-Sync Compatible

Но в 2019 году NVIDIA пошли навстречу покупателям и добавили поддержку стандарта VESA Adaptive Sync в драйвера для своих видеокарт серии RTX, а также для карточки GTX 1080. А значит теперь можно легко насладиться лучшим из двух миров: взять себе карточку от NVIDIA и монитор с FreeSync по вкусу. Вот только есть проблема. Если на FreeSync мониторе не написано G-Sync Compatible — значит он не был протестирован NVIDIA на совместимость и никаких гарантий, что всё будет работать нормально, вам никто не даёт. А NVIDIA тестирует далеко не все, и далеко не самые доступные модели.

А NVIDIA тестирует далеко не все, и далеко не самые доступные модели.

Поэтому инициативу по тестированию в свои руки взяло интернет-сообщество. Они составили табличку с огромным списком протестированных пользователями мониторов.

VRR

С мониторами, кажется, разобрались. Но как быть, если хочется поиграть на большом экране телевизора через консоль или ПК. Будет ли работать адаптивная синхронизация? Спешу вас порадовать — будет! При условии что ваш ТВ оснащен портом HDMI версии 2.1, в который добавили технологию переменной частоты обновления VRR — Variable Refresh Rate.

Причём всё будет работать и с видеокартами от NVIDIA и с Radeon. Всё потому, что VRR — это та же самая технология VESA Adaptive Sync, но теперь она стала ещё и частью стандарта HDMI 2.1. Именно таким образом адаптивная синхронизация реализована в консолях нового поколения. А также, вы удивитесь, в Xbox One S и One X. Да, в коробки текущего поколения от Microsoft VRR завезли даже раньше, чем HDMI 2. 1.

1.

Итоги

Что, в итоге спустя 6 лет после своего появления, технология Adaptive Sync стала фактически отраслевым стандартом. Захватив видеокарты от AMD и NVIDIA, телевизоры и даже интегрированная графика от Intel в 11-м поколении процессоров теперь поддерживает эту технологию. А это значит, что в светлом будущем мы будем жить без единого разрыва, по крайней мере, вертикального!

Post Views: 7 437

NVIDIA снизила требования к мониторам с технологией G-Sync Ultimate

Компания NVIDIA без официального анонса снизила требования к мониторам с поддержкой фирменной технологии G-Sync. Она используется для динамической синхронизации частоты обновления экрана монитора с частотой кадров, выдаваемых видеокартой, и направлена на то, чтобы устранить разрывы изображения при смене кадров на экране.

Технология G-Sync появилась раньше, чем аналогичная технология AMD FreeSync, и изначально предполагала оснащение мониторов специальным проприетарным оборудованием. При этом аналогичная технология от AMD не требовала использования в мониторах дополнительного оборудования и поэтому быстро завоевала популярность среди производителей и потребителей. В итоге NVIDIA пришлось более гибко подойти к вопросу интеграции поддержки G-Sync. Она предложила три вида своей технологии: G-Sync Compatible (совместимость с G-Sync без наличия специальных аппаратных средств), поддержка G-Sync (монитор оснащается модулем NVIDIA), а также полная поддержка G-Sync Ultimate (аналогично предыдущему, только для мониторов с поддержкой HDR).

При этом аналогичная технология от AMD не требовала использования в мониторах дополнительного оборудования и поэтому быстро завоевала популярность среди производителей и потребителей. В итоге NVIDIA пришлось более гибко подойти к вопросу интеграции поддержки G-Sync. Она предложила три вида своей технологии: G-Sync Compatible (совместимость с G-Sync без наличия специальных аппаратных средств), поддержка G-Sync (монитор оснащается модулем NVIDIA), а также полная поддержка G-Sync Ultimate (аналогично предыдущему, только для мониторов с поддержкой HDR).

Для G-Sync Ultimate компанией были заданы особые требования. Например, ещё в рамках выставки CES 2019 компания заявила следующие необходимые спецификации для мониторов с поддержкой G-Sync Ultimate:

- Яркость дисплея выше 1000 кд/м2;

- Поддержка высокого разрешения и частоты обновления;

- Быстрый отклик матрицы;

- Многозонная подсветка;

- Широкий охват цветового пространства;

- Оснащение продвинутым процессором NVIDIA G-Sync;

Однако в ходе выставки CES 2021, когда было объявлено, что три новых монитора прошли сертификацию G-Sync Ultimate, выяснилось, что два из них не соответствуют изначальным требованиям — они не имеют сертификата VESA DisplayHDR 1000. При этом у них есть сертификат VESA DisplayHDR 600, но это противоречит ранним требованиям NVIDIA к стандарту G-Sync Ultimate.

При этом у них есть сертификат VESA DisplayHDR 600, но это противоречит ранним требованиям NVIDIA к стандарту G-Sync Ultimate.

Более того, изменения обнаружились и на сайте NVIDIA в разделе G-Sync. Производитель убрал упоминание яркости 1000 кд/м2 и вместо этого указал в качестве требования к дисплею наличие поддержки «реалистичного HDR». Иными словами, теперь поддержка G-Sync Ultimate не означает яркости дисплея выше 1000 кд/м2.

NVIDIA заявила, что поддержку G-Sync Ultimate получили мониторы ASUS PG32UQX (пиковая яркость 1400 кд/м2), MSI MEG MEG381CQR (HDR 600) и LG 34GP950G (HDR 600).

Если вы заметили ошибку — выделите ее мышью и нажмите CTRL+ENTER.

G-Sync vs FreeSync и VSync

Игровой сектор растет со все возрастающей скоростью. В последние годы появились новые технологии, которые позволяют лучше взаимодействовать с видеоиграми и повышать реализм. В этой статье мы расскажем, что такое технология Nvidia G-Sync и как она работает.

Эта технология все чаще встречается в мониторах, а также в телевизорах, хотя обычно она доступна только в высококачественных моделях. Однако, если вы настоящий геймер, то вам рекомендуется создать команду, обладающую этой технологией. Попробуем разобраться, из чего состоит технология G-Sync, какие преимущества она дает при игре и почему это важно. Также расскажем, что лучше: G-Sync или FreeSync.

Nvidia G-Sync — это:

G-Sync — это технология, разработанная известной компанией Nvidia — брендом, специализирующимся на видеокартах и других аппаратных компонентах. Опция G-Sync синхронизирует частоту кадров (FPS) видеокарты, поддерживающей эту функцию, с частотой обновления (Гц) монитора c поддержкой G-Sync.

Это дает преимущество динамической или переменной частоты обновления, которая полностью устраняет так называемый эффект разрыва изображения и «заикание экрана», устранение пометок экрана, задержки ввода VSync и пропусков. Обычные мониторы работают с фиксированной частотой обновления 60 Гц, 100 Гц, 144 Гц.

Это означает, что экран обновляется 60 раз за одну секунду (если это монитор с частотой 60 Гц) для создания изображения. Графический процессор в первую очередь должен, конечно, отрендерить определенное количество кадров и отправить их на экран.

Если графический процессор недостаточно мощный, чтобы поддерживать частоту обновления монитора, видеоигры будут вызывать заикание изображения на экране. Если карта отправляет больше кадров, чем частота обновления монитора, будут возникать микроотрезы. Именно здесь вступает в игру технология GSync, которая устраняет или значительно снижает эти проблемы.

Частота кадров в секунду остается в диапазоне динамической частоты обновления, который начинается с 30 Гц / fps и заканчивается максимальной частотой обновления монитора. Как мы уже говорили, экраны, поддерживающие G-Sync, обычно стоят намного дороже. Это связано с тем, что, в отличие от обычных игровых, мониторы G-Sync имеют специальный встроенный модуль для включения переменной частоты обновления.

Сертификаты G-Sync и их различия

В экосистеме G-Sync существует три типа сертификатов, позволяющих дифференцировать конечную производительность. Высшим является Ultimate, затем стандарт G-Sync и наконец тот, который классифицируется как просто совместимый.

G-Sync Ultimate

Версия под названием Ultimate обеспечивает поддержку игр HDR с минимальной задержкой ввода, сохраняя при этом все оригинальные преимущества G-Sync.

Требования к Nvidia G-Sync Ultimate

G-Sync видеокарта GTX 1050 или выше.

Монитор с максимальной яркостью не менее 1000 нит, цветовым пространством DCI-P3 и подсветкой Директ.

DisplayPort 1.4.

Переменная частота обновления, разгон и ULMB.

Мониторы с поддержкой G-Sync

Это стандартная версия, которая в отличие от версии Ultimate G-Sync, не имеет специальных характеристик для HDR.

G-Sync compatible

Сертификат Nvidia G-Sync compatible (совместимый), который Nvidia предлагает мониторам и телевизорам. На самом деле устройства с таким сертификатом не используют процессоры Nvidia. Однако они подтверждены брендом, который дает гарантию, что это устройство совместимо с переменной частотой обновления (VRR) и обеспечит хороший игровой процесс без фрагментации или мерцания изображения.

Помимо того, что у этих устройств нет собственного встроенного модуля, они также не прошли 300 тестов, которые компания проводит для обеспечения качества. Эту сертификацию можно найти в самых дешевых моделях мониторов. В то же время это хорошая отправная точка для тех, кто хочет получить удовольствие от игрового монитора, но без особых затрат.

Телевизоры с G-Sync

Как мы уже сообщали ранее, в сентябре 2019 года Nvidia заключила партнерское соглашение с LG, чтобы включить переменную частоту обновления на OLED-телевизорах LG C9, E9 и Z9 через HDMI 2.1. Из новой линейки 2020 совместимыми моделями являются новые серии с G-Sync: LG BX, CX, GX и ZX. Благодаря этим моделям LG OLED достигается низкая задержка и отклик в играх с переменной частотой обновления без разрывов или задержки ввода.

Мониторы FreeSync, совместимые с G Sync

Существует большое количество мониторов, которые совместимы не с G-Sync, а с поддержкой FreeSync. Некоторые из этих моделей могут также поддерживать и VRR FreeSync на видеокартах Nvidia. Однако в этом случае качество производительности не гарантируется.

В январе 2019 года Nvidia выпустила обновление драйвера, которое позволяет видеокартам GTX 10, GTX 16 и RTX 20 (или новее) использовать переменную частоту обновления через DisplayPort на мониторах с технологией FreeSync.

Кроме того, будущие Nvidia G-Sync мониторы будут поддерживать Adaptive Sync через HDMI и DisplayPort. На сегодняшний день многие мониторы Nvidia сертифицированы как совместимые с G-Sync. Это означает, что подобные мониторы FreeSync работают без мерцания, визуальных артефактов, чрезмерного двоения изображения или других проблем.

ULMB (сверхнизкое размытие при движении)

Хотя G-Sync обеспечивает более плавный игровой процесс, предотвращая разрывы экрана, уменьшая заикание и уменьшая задержку ввода, она не влияет на размытие при движении. По этой причине многие мониторы, поставляемые с G-Sync, также имеют функцию под названием ULMB.

Когда эта технология активирована, она запускает сканирование подсветки для уменьшения ощущения размытости изображения. Режим ULMB работает только при определенных заранее заданных фиксированных частотах обновления, таких как 100 Гц, 120 Гц и т. д., и не может быть активирован одновременно с G-Sync. Также стоит отметить, что использование ULMB имеет важный недостаток. Она значительно снижает яркость.

G-Sync vs FreeSync и VSync — отличия

VSync

Чем отличается G-Sync от FreeSync и VSync? Для начала следует знать, что G-Sync — это улучшенная версия VSync. VSync можно найти в настройках драйвера дисплея или в настройках видеоигры. Если включить VSync, то графический процессор будет удерживать кадр до тех пор, пока монитор не будет готов к его отображению. Это устраняет разрыв экрана, но увеличивает задержку ввода.

Когда VSync в играх отключена, графический процессор отправляет изображения непосредственно на монитор сразу после отрисовки. При выключенной VSync отправка изображения происходит независимо от того, завершил ли монитор цикл обновления и готов ли он перейти к следующему изображению. В результате пользователь может наблюдать частые разрывы экрана. Владельцам видеокарты с FreeSync AMD следует искать обычный игровой монитор с поддержкой FreeSync.

FreeSync

FreeSync — это технология, разработанная AMD. Она является прямым конкурентом GSync. Технологию AMD FreeSync легче внедрить, потому что она дешевле и проще в реализации. Мониторы FreeSync не имеют дополнительных затрат, поскольку в них нет специального модуля внутри дисплея. Однако мониторы FreeSync обычно имеют более узкий динамический диапазон.

Например, монитор G-Sync 144 Гц имеет динамический диапазон 30–144 Гц, а стандартный монитор FreeSync 144 Гц обычно имеет диапазон VRR 48–144 Гц. Конечно, бывают исключения, когда монитор FreeSync может иметь такой же широкий динамический диапазон, но такие мониторы встречается реже.

Большинство мониторов FreeSync также поддерживают технологию AMD LFC, которая обеспечивает плавную работу за счет умножения частоты обновления, когда частота кадров в секунду падает ниже динамического диапазона. Наконец, все дисплеи G-Sync поддерживают Variable Overdrive. Это позволяет динамически изменять время отклика в зависимости от текущей частоты обновления.

В результате устраняется сдвоенное изображение при высокой частоте кадров и лишние пиксели при низкой частоте кадров. Мониторы AMD Free-Sync не могут динамически изменять время отклика перегрузки. Поэтому, если появляется агрессивная перегрузка, и частота кадров падает, это приводит к излишним пикселям. К счастью, такое случается нечасто.

Так что же лучше: FreeSync или G-Sync

В целом технология FreeSync позиционируется как лучшая альтернатива для геймеров с ограниченным бюджетом. С другой стороны, G-Sync действительно предлагает лучшую производительность и является лучшим вариантом. Монитор с опцией G-Sync следует выбирать в том случае, если вы ценитель высочайшего качества изображения и готовы за это переплатить.

https://ultrahd.su/video/g-sync-vs-freesync-vs-vsync.htmlG-Sync vs FreeSync и VSync — отличияultrahdВидеовидеоИгровой сектор растет со все возрастающей скоростью. В последние годы появились новые технологии, которые позволяют лучше взаимодействовать с видеоиграми и повышать реализм. В этой статье мы расскажем, что такое технология Nvidia G-Sync и как она работает. Эта технология все чаще встречается в мониторах, а также в телевизорах, хотя обычно она…ultrahdultrahd AdministratorUltraHDКак включить и проверить G-Sync на игровом мониторе FreeSync

В наши дни игры с высокой частотой обновления, безусловно, стали золотым стандартом компьютерных игр. С появлением хороших мониторов с частотой 120 Гц, 144 Гц и 165 Гц с разрешениями 1080p и 1440p, за последние несколько лет перспективы игровой индустрии для ПК сильно изменились. Технология мониторов временами быстро опережала технологические достижения в других областях, таких как графические процессоры. Даже в 2020 году лучшие игровые мониторы на рынке могут развивать частоту обновления до 165 Гц на панелях 4K, с чем реально не справится даже могучая GeForce RTX 3090. Таким образом, такой быстрый прогресс в технологиях мониторов привел к быстрому увеличению количества бюджетных мониторов с высокой частотой обновления на рынке. Эти мониторы представляют большую ценность для потребителей, ищущих безупречные игры по доступной для кошелька цене.

Теперь можно включить G-Sync на мониторе FreeSync – Изображение: ViewsonicИгры с высокой частотой обновления также имеют свою долю причуд. Есть некоторые вещи, которых следует опасаться при покупке монитора с высокой частотой обновления. Помимо разрешения и частоты обновления, многие мониторы на рынке также указывают функцию, называемую Adaptive Sync, на странице продукта или даже в названии продукта. Эта функция реализована в формах Nvidia G-Sync или AMD FreeSync, и вполне возможно, что вы слышали об этих технологиях, когда-либо покупали игровой монитор. Адаптивная синхронизация – одна из ключевых функций, которую обязательно следует учитывать при принятии решения о покупке.

Адаптивная синхронизация

Так что же такое адаптивная синхронизация? Проще говоря, адаптивная синхронизация – это технология VESA, которая изменяет частоту обновления монитора в соответствии с FPS, создаваемым видеокартой. По сути, эта технология направлена на сглаживание визуального вывода, который получает пользователь, путем синхронизации частоты обновления монитора с количеством кадров, производимых самой видеокартой. Эта технология может существенно повлиять на общее впечатление, производимое этими мониторами.

Отсутствие адаптивной синхронизации

Существует довольно много проблем, которые могут испортить впечатление пользователя, если в мониторе отсутствует какая-либо реализация адаптивной синхронизации, будь то G-Sync от Nvidia или FreeSync от AMD. Как правило, любая из двух реализаций адаптивной синхронизации приводит к значительному улучшению воспринимаемого вывода монитора. Отсутствие адаптивной синхронизации может привести к следующим проблемам:

- Разрыв экрана: это довольно раздражающий артефакт, который может сильно раздражать визуальное восприятие во время игры. Обычно это происходит при высокой частоте кадров, когда количество кадров в секунду, выдаваемое видеокартой, превышает частоту обновления монитора. На дисплее появляется два или более кадра в течение одного цикла обновления, и изображение выглядит разорванным с видимыми линиями.

- Отсутствие плавности: отсутствие какой-либо технологии адаптивной синхронизации приводит к значительному снижению воспринимаемой плавности движения на выходе дисплея. Это происходит из-за различного времени кадра в игре в сочетании с фиксированной частотой обновления дисплея.

- Существенные подтормаживания: если частота кадров в игре довольно низкая (скажем, даже ниже 50 кадров в секунду), технологии адаптивной синхронизации могут помочь улучшить плавность игры даже при такой частоте кадров за счет снижения частоты обновления дисплея, чтобы она соответствовала частоте кадров, предоставляемой игра. Это может быть полезно в играх с очень интенсивной графикой.

AMD FreeSync

FreeSync – это реализация AMD технологии адаптивной синхронизации, в которой APU и видеокарты AMD могут управлять частотой обновления монитора, к которому они подключены. Это позволяет им изменять частоту обновления монитора, чтобы синхронизировать ее с частотой кадров, которую карта производит в конкретной игре или 3D-приложении. Обычно мониторы FreeSync дешевле, чем их аналоги G-Sync, потому что AMD не выбрала какой-либо проприетарный модуль в этих мониторах, а полагается на платы масштабирования VESA Adaptive Sync, встроенные в дисплеи. Однако AMD заверила пользователей, что брендинг FreeSync применяется только после тщательного тестирования и сертификации.

Технология AMD FreeSync – Изображение: AMDNvidia G-Sync

G-Sync – это бренд Nvidia для реализации технологии адаптивной синхронизации. Он работает почти так же, как метод AMD FreeSync, но Nvidia добавила еще несколько шагов для дальнейшей персонализации процесса. В то время как AMD FreeSync работает как через HDMI, так и через Displayport, стандарт Nvidia G-Sync использует исключительно кабельную технологию Displayport. Однако более важным является то, что теперь в мониторах доступны различные типы G-Sync.

G-Sync теперь доступен в 3-х различных «вариантах» для мониторов. Существует стандарт G-Sync, который требует, чтобы на мониторе был установлен отдельный отдельный модуль G-Sync, чтобы эффективно использовать технологию адаптивной синхронизации, а также есть G-Sync Ultimate, который также требует этого модуля и даже больше. тщательно протестирован и сертифицирован для обеспечения высочайшего уровня возможностей G-Sync. Эти аппаратные модули увеличивают стоимость самого дисплея, и поэтому мониторы FreeSync обычно дешевле, чем мониторы G-Sync в тех же категориях спецификаций. Производительность этих двух технологий более или менее одинакова.

3 типа реализаций Nvidia G-Sync в мониторах – Изображение: NvidiaЕсть еще один действительно интересный тип реализации G-Sync, который называется технологией G-Sync Compatible.

Мониторы, совместимые с G-Sync

Эти мониторы не имеют аппаратного модуля, который есть в других мониторах G-Sync, поэтому они также дешевле, чем более дорогие мониторы G-Sync и G-Sync Ultimate. Мониторы, совместимые с G-Sync, могут полностью использовать G-Sync с использованием традиционных модулей масштабирования Adaptive Sync, таких как FreeSync. Фактически, Nvidia сертифицировала только несколько мониторов как «совместимые с G-Sync», но многие мониторы FreeSync на рынке прямо сейчас отлично работают с G-Sync в паре с видеокартой Nvidia GeForce.

Различия между G-Sync Compatible, G-Sync и G-Sync UltimateПолный список сертифицированных мониторов, совместимых с G-Sync, можно найти ВотОднако это относительно короткий список, в нем всего несколько мониторов от нескольких брендов. Тем не менее, большое количество мониторов FreeSync (и других мониторов с Adaptive Sync) было протестировано на предмет безупречной работы с G-Sync с помощью нескольких простых шагов в сочетании с графической картой Nvidia. Если у вас есть монитор FreeSync, на котором вы хотите запустить G-Sync, выполните действия, указанные ниже.

Пошаговое руководство по включению G-Sync на мониторе FreeSync

Это простой пошаговый процесс включения G-Sync на мониторе FreeSync. Этот процесс можно использовать для проверки того, будет ли G-Sync работать с вашим монитором FreeSync или Adaptive Sync.

Шаг 1. Включите Monitor FreeSync

Прежде всего, вы должны включить FreeSync монитора, используя собственные элементы управления монитора. Возможно, вам придется просмотреть несколько страниц параметров, чтобы найти этот параметр. Его также можно обозначить как «Adaptive Sync». При выполнении этого процесса убедитесь, что вы подключены через Displayport, а не через HDMI. Это необходимо, потому что, хотя FreeSync действительно работает через HDMI, G-Sync требует подключения Displayport для оптимальной работы.

Шаг 2. Откройте панель управления Nvidia.

Щелкните правой кнопкой мыши на рабочем столе и откройте панель управления Nvidia. Мы предполагаем, что у вас есть видеокарта Nvidia в системе, которая поддерживает G-Sync и последние доступные драйверы от Nvidia.

Щелкните правой кнопкой мыши на рабочем столе и откройте панель управления Nvidia.Шаг 3. Настройте G-Sync

Когда панель управления откроется, вы должны увидеть «Настроить G-Sync» на левой панели панели управления. Выберите этот вариант. Если он не появляется, попробуйте перезапустить панель управления или компьютер. Вы также можете попробовать подключить кабель Displayport к другому порту.

Шаг 4. Включите G-Sync

После выбора параметра «Настроить G-Sync» в правой части панели управления появится несколько параметров. В первой настройке установите флажок «Включить G-SYNC, G-SYNC Compatible», а также выберите «Включить для полноэкранного режима». Нажмите «Применить» и выйдите из панели управления.

Экран может мерцать после нажатия кнопки «Применить», это нормально. Мы также не рекомендуем выбирать параметр «Включить для оконного и полноэкранного режима», поскольку это включит G-Sync в нежелательных местах, таких как веб-браузеры, где он может работать не так, как задумано.

Если у вас более одного дисплея, вы также можете изменить конкретную настройку G-Sync для отдельных дисплеев, используя второй и третий параметры в этом окне. В этом окне может появиться предупреждение о том, что выбранный дисплей не подтвержден как совместимый с G-Sync. Это сообщение можно проигнорировать, поскольку Nvidia сертифицировала только несколько мониторов как совместимые с G-Sync.

Шаг 5. Протестируйте с помощью демонстрации G-Sync Pendulum

После включения G-Sync нам нужно проверить, действительно ли он работает правильно. У Nvidia есть удобный инструмент для этого процесса на своем веб-сайте. Инструмент, известный как «G-Sync Pendulum Demo», можно скачать с веб-сайта Nvidia и это идеальный тест для нашего конкретного сценария.

После загрузки и установки демоверсии откройте исполняемый файл «G-Sync Pendulum Demo». Монитор будет переключать разрешения, и зрителю будет представлена сцена с маятником с несколькими ползунками и переключателями. Здесь следует отметить, что в верхнем левом углу экрана будет 3 варианта. Параметры будут называться «VSync», «Без VSync» и «G-Sync». Если G-Sync может быть успешно выбран, монитор отлично использует технологию G-Sync. Вы также можете провести дальнейшее тестирование с помощью этой демонстрации, изменяя частоту кадров и ища разрывы экрана или другие артефакты во время работы демонстрации.

G-Sync в верхнем левом углу экрана показывает, что G-Sync был успешно включен.И эт вуаля! Ваш монитор FreeSync отлично работает с Nvidia G-Sync. Обязательно проверьте эффективность G-Sync в играх и во время длительных игровых сессий. Это позволит вам проверить долгосрочную надежность работы G-Sync на вашем конкретном мониторе FreeSync.

Преимущества FreeSync и G-Sync

G-Sync и FreeSync – это очень впечатляющие технологии, которые считаются практически незаменимыми для компьютерных геймеров, ищущих идеальный игровой процесс с высокой частотой обновления. Нет ничего более раздражающего, чем игра, якобы работающая с высокой частотой кадров, но представляющая огромное количество разрывов экрана, которые портят визуальное восприятие. FreeSync и G-Sync чрезвычайно эффективны при устранении упомянутых разрывов экрана, что обеспечивает плавный игровой процесс без артефактов при высокой частоте обновления.

Преимущества G-Sync (и FreeSync) – Изображение: NvidiaЭти технологии также улучшают общую воспринимаемую плавность игры, поскольку они помогают поддерживать согласованное время кадров за счет синхронизации частоты кадров игры с частотой обновления монитора. Более того, адаптивная синхронизация также может помочь на другом конце спектра, уменьшая влияние низкой частоты кадров на визуальный результат игры. С G-Sync и FreeSync даже низкая частота кадров может быть значительно более плавной, чем нормальный вывод без какой-либо технологии адаптивной синхронизации. Это может значительно помочь, если видеокарта недостаточно мощная, чтобы поддерживать стабильные 60 кадров в секунду в конкретной игре с определенным разрешением.

Заключение

Итак, поехали! Процесс включения G-Sync на FreeSync или на обычном мониторе Adaptive Sync довольно прост и понятен. Конечно, совместимость G-Sync не гарантируется на всех мониторах FreeSync, но большое количество мониторов было протестировано пользователями на предмет безупречной работы с включенной G-Sync. Наше тестирование проводилось на мониторе FreeSync Monoprice Zero-G 1440p 144 Гц, который использует стандартный стандарт адаптивной синхронизации VESA. G-Sync был протестирован на предмет безупречной работы с этим монитором, даже несмотря на то, что он не указан в списке Nvidia для мониторов, совместимых с G-Sync. Конечно, следует поблагодарить Nvidia за то, что это стало возможным и за устранение необходимости в установке проприетарного модуля G-Sync в монитор, чтобы G-Sync работала.

Это позволило большому количеству более дешевых мониторов FreeSync быть совместимыми не только с FreeSync, но и с G-Sync, что может быть огромным преимуществом для людей, ищущих наиболее выгодную покупку. Этот процесс также может оказаться весьма кстати, если вы приобрели монитор FreeSync для использования с видеокартой AMD, но позже купили видеокарту Nvidia, которая не могла использовать технологию FreeSync. С помощью этого процесса на этом мониторе можно включить G-Sync, чтобы обеспечить такой же уровень плавности и такую же эффективность при удалении раздражающих артефактов, таких как разрыв экрана.

Разбираемся, что такое G-Sync, FreeSync, V-Sync и нужны ли они вообще

Для комфортной игры всегда важно не только качество картинки (о чём мы говорили отдельно), но и частота её обновления, которая зависит от многих факторов — модели монитора, мощности компьютера и метода синхронизации. В этой статье мы рассмотрим существующие виды синхронизаций: вертикальную и адаптивную синхронизации, а также G-Sync и FreeSync, чтобы понять, в чем между ними разница и что лучше использовать.Связь видеокарты с монитором и её проблемы

Прежде всего следует напомнить, как работает видеокарта и монитор компьютера. Во время игры видеокарта формирует кадры. Рендер каждого кадра занимает какое-то время и чем сам кадр сложнее, тем рендер дольше — увеличивают время рендера разрешение экрана, качество и количество эффектов и объектов и так далее. Сформированный кадр посылается на монитор, и видеокарта начинает создавать следующий кадр. Проблема в том, что время рендера кадра и его время на мониторе не всегда совпадают. Все проблемы начинаются отсюда.В идеальном случае эти два отрезка времени должны быть равны — тогда, когда на мониторе закончится старый кадр, к нему подоспеет новый кадр и они плавно пойдут друг за другом, не создавая проблем. Но видеокарта может «обгонять» монитор.

И тут необходимо понимать, что мониторы работают с определёнными частотами обновления — количеством обновления кадров в секунду. Измеряется частота обновления в герцах. Мониторы с 60 Гц обновляют картинку 60 раз за секунду, 144 Гц — 144 раза за секунду.

Возвращаясь к видеокарте и монитору — значение кадров в секунду, выходящих из видеокарты, плавает, и может быть как меньше 60, так и больше. Оба случая приводят к проблемам.

Если кадры «тяжёлые» (большой взрыв трёх машин в 4K-разрешении, например), то рендер будет долгим и видеокарта может выдать меньше 60 кадров за секунду. Из-за этого монитору не хватает кадров, чтобы воспроизвести одну секунду, и игра компенсирует это и формирует кадры, где действие проходит быстрее, чтобы игровой процесс не замедлился. Но потом «тяжёлые» кадры проходят, и время рендера становится прежним. Но игра ещё не успела перестроиться и по-прежнему заставляет рендерить ускоренные кадры — из-за чего в какой-то момент может пойти смещение и возникнет статтер. Пример работы такого алгоритма — ниже (в верхней части ролика все кадры рендерятся за одинаковое время, в нижней время колеблется).

Обратный вариант: видеокарта рендерит больше кадров в секунду, чем способен показать монитор. Это приводит к тому, что на мониторе может появиться сразу несколько кадров.

Подобные разрывы бросаются в глаза, и их частое появление может вызвать тошноту, боль в глазах или головокружение. В таком случае речь идёт не просто о плавной игре, но и о здоровье человека, потому борьбе с подобным уделено большое внимание. Ниже рассмотрены методы синхронизации видеокарты и монитора, которые позволяют избавиться от подобных проблем.

Вертикальная синхронизация — дёшево и сердито

Вертикальная синхронизация (Vertical Synchronization, V-Sync) — своеобразный «костыль», редко помогающий сам по себе. Принцип работы прост: он замедляет видеокарту, заставляя её выпускать столько кадров в секунду, сколько может производить монитор. Таким образом, «лишних кадров» не появляется и видеокарта синхронизирована с монитором. Но проблемы есть: если возможный FPS значительно превышает заданный синхронизацией, то игра хуже реагирует на действия игрока — многие жалуются, что кажется, будто персонаж (независимо от игры) двигается «как в молоке».При падении FPS V-Sync больше портит, чем помогаетПри падении FPS V-Sync больше портит, чем помогает

Тем не менее, не решается проблема и с кадрами, которые рендерятся дольше и из-за которых видеокарта выдаёт в секунду меньше, чем может показать монитор. Потому что V-Sync в таком случае сокращает число выводимых кадров до кратного частоте монитора. Например, если у вас монитор с 60 Гц, а видеокарта выводит 55 кадров в секунду, то V-Sync срежет выводимое число кадров до 30, чтобы картинка шла плавнее. В результате FPS падает и ощущения становятся ещё хуже.

Адаптивная синхронизация — старший брат V-Sync

Nvidia разработала адаптивную синхронизацию на замену вертикальной. Принцип её действия прост — если видеокарта выдаёт больше 60 кадров в секунду, V-Sync включается автоматически. Если кадров меньше необходимого — вертикальная синхронизация отключается. Если частота выше — работает вертикальная синхронизация и убирает разрыв изображения. Если частота ниже — она не блокируется на конкретном значении и (в теории) всё работает хорошо.Однако на практике подобный метод помогает не всегда и проблемы вертикальной синхронизации всё ещё могут встречаться.

G-Sync — дорого, но эффективно

Ещё один способ от Nvidia. Компания разработала специальные мониторы G-Sync, которые подстраивают свою частоту под частоту видеокарты. То есть, если на монитор G-Sync с частотой 120 Гц подаётся 80 FPS, то монитор снизит свою частоту до 80 Гц.Убирая все минусы вертикальной синхронизации (статтеринг, разрыв изображения, задержку управления), G-Sync является очень хорошим вариантом. Но, вместе с этим, очень дорогим, так как G-Sync работает только на мониторах с предустановленным чипом от Nvidia и требует повышенной мощности.

FreeSync — упрощённая G-Sync

После G-Sync, основным порогом которой стала цена, AMD представила свой вариант — Radeon FreeSync. Принцип работы FreeSync не отличается от G-Sync: монитор синхронизируется с видеокартой и работает на её частоте.На 1:49 — сравнение G-Sync и FreeSync в замедленной съёмке.

Однако свои отличия есть. Если G-Sync продолжает работать по этому принципу на низких FPS, мониторы с FreeSync начинают использовать «традиционные» методы синхронизации, возвращая старые помехи — и статтер, и разрыв изображения, и задержку управления.

Но если G-Sync использует свой собственный чип, FreeSync работает на DisplayPort — уже разработанной до этого технологии. Говоря кратко: для FreeSync тоже нужен специальный монитор, но FreeSync-монитор будет дешевле монитора с G-Sync.

VRR и совместимость FreeSync с G-Sync

На CES 2019 Nvidia представила новое внедрение G-Sync — теперь синхронизация монитора будет обеспечена функцией Variety Refresh Rate (VRR, присутствует в HDMI 2.1) и видеокартами Nvidia GTX 10 поколения или Nvidia RTX 20 поколения. Для такой технологии требуется монитор с FreeSync.Из 400 проверенных мониторов с FreeSync 12 точно будут работать в полную мощность G-SyncИз 400 проверенных мониторов с FreeSync 12 точно будут работать в полную мощность G-Sync

Это значительно расширяет список подходящих мониторов, а также даёт шанс, что любой монитор сможет работать с G-Sync.

С развитием технологий синхронизации стоит ждать всё более новых и новых методов, сочетающих в себе качество и доступность. Возможно, уже очень скоро играть без любых помех сможет обладатель очень бюджетного компьютера.

Как работает G-Sync compatible: проверяем на мониторе Asus VG278Q

Как включить G Sync Compatible?

В противном случае, вы можете включить эту функцию вручную, предприняв еще некоторые действия.

- Откройте панель управления Nvidia в правой нижней части рабочего стола Windows.

- Выберите «Display» (дисплей) и нажмите «Set up G-SYNC» (настроить G-SYNC).

- Выберите «Enable G-SYNC Compatible» (включить совместимость с G-SYNC).

Как работает технология G Sync?

ТЕХНОЛОГИЯ G-Sync

Революционная производительность G-SYNC достигается за счет синхронизации скорости регенерации изображения дисплея с GeForce GTX GPU, установленным в вашем ПК или ноутбуке. Это устраняет разрывы и минимизирует дрожание и задержки изображения.

Какие карты Nvidia поддерживают FreeSync?

Технологию AMD FreeSync можно использовать с видеокартами NVIDIA GeForce. … Например, выяснилось, что видеокарты GeForce GTX 10-й серии поддерживают работу с технологией синхронизации частоты смены кадров AMD FreeSync. Конечно, сами по себе видеокарты GeForce поддерживают только технологию синхронизации NVIDIA G-Sync.

Как установить G Sync?

Подключив все, откройте панель управления NVIDIA на вашем ПК, щелкнув правой кнопкой мыши на рабочем столе Windows и выбрав «Панель управления NVIDIA», или запустив приложение «Панель управления NVIDIA» в меню «Пуск». Голова на дисплей> Настройка G-SYNC. Убедитесь, что опция «Включить G-SYNC» включена.

Какие мониторы поддерживают FreeSync?

Чтобы ознаменовать начало 2019 года, Nvidia объявила о поддержке FreeSync в видеокартах GeForce.

…

Вот 22 монитора, совместимых с G-Sync, которые в настоящее время рекомендует Nvidia:

- Acer XFA240.

- Acer XG270HU.

- Acer Nitro XV273K.

- Acer XZ321Q.

- Acer XF250Q.

- Acer ED273A.

- Acer KG271.

- Acer XF240H.

Как включить FreeSync Nvidia?

Включить FreeSync на Nvidia

- В открывшемся окне (см. выше) в списке выбрать «Настройка G-SYNC».

- Поставить галочку «Enable G-SYNC…»

- Ниже, напротив «Enable settings for the selected display model» тоже ставим галку.

- Жмем «Применить»

Как работает FreeSync?

AMD FreeSync или Adaptive Sync. Подход FreeSync идентичен G-Sync: подёргивания минимизируются, разрывание картинки полностью устраняется, монитор выводит частоту кадров с той скоростью, с которой она просчитывается видеокартой. AMD FreeSync или Adaptive Sync. AMD не выделяет отличий между FreeSync и Adaptive Sync.

Какие видеокарты поддерживают G Sync?

G-SYNC поддерживает следующие видеокарты NVIDIA: GeForce GTX TITAN Black, GeForce GTX TITAN, GeForce GTX 780 Ti, GeForce GTX 780, GeForce GTX 770, GeForce GTX 760, GeForce GTX 750 Ti, GeForce GTX 750, GeForce GTX 690, GeForce GTX 680, GeForce GTX 670, GeForce GTX 660 Ti, GeForce GTX 660, and GeForce GTX 650 Ti BOOST.

Для чего нужен G Sync?

G-Sync — это собственная адаптивная технология синхронизации, разработанная компанией NVIDIA, направленная прежде всего на устранение разрывов экрана и потребность в программных сдерживающих факторах, таких как V-Sync.

Что такое G Sync Compatible?

Маркировка «G-SYNC Compatible» подтверждает, что монитор не мерцает, не мигает и работает без разрывов изображения и других помех во время игрового процесса с VRR.

Как включить Adaptive Sync?

Найдите раздел отвечающие за игры или технологию FreeSync, либо Adaptive Sync, в случае необходимости активируйте параметр. Теперь запустите на компьютере «Панель управления Nvidia» и далее перейдите в раздел «Настроить G-SYNC». После чего активируйте параметр «Включить G-SYNC, совместимый с G-SYNC».

Как включить NVIDIA G-Sync на вашем ПК

NVIDIA G-Sync — это технология, лицензированная производителем графических процессоров компаниям, производящим дисплеи для ПК и ноутбуков. В двух словах, он обеспечивает плавную и плавную игру без разрывов, позволяя монитору и графическому процессору взаимодействовать друг с другом. Дисплей отображает каждый кадр, выводимый графическим процессором, и эта переменная частота обновления гарантирует отсутствие разрывов во время игры. Однако он не активируется по волшебству, как только вы подключаете дисплей G-Sync. Вот что вам нужно сделать.

Как включить G-Sync на вашем ПК

Первое, что нужно сделать, это убедиться, что вы действительно включили настройку G-Sync на своем ПК.

- Щелкните правой кнопкой мыши на рабочем столе.

- Выберите Панель управления NVIDIA.

Разверните display элемент на боковой панели.

- Нажмите , чтобы настроить G-Sync.

- Установите флажок рядом с , чтобы включить G-Sync.

- Ниже выберите, хотите ли вы, чтобы G-Sync был включен только для полноэкранного или полноэкранного и оконного режимов.

Как использовать G-Sync в компьютерных играх

Чтобы использовать G-Sync в играх, вам также необходимо настроить монитор в качестве основного дисплея на этой же панели управления, если вы используете несколько мониторов.

- В том же окне, что и выше, щелкните , чтобы настроить несколько дисплеев.

- Убедитесь, что монитор G-Sync находится в правильном месте и выделен как основной.

Если вам нужно сделать его основным дисплеем, выполните следующие действия.

- Откройте приложение настроек Windows 10 .

- Щелкните систему .

- Теперь щелкните по дисплею .

- Выделите поле, соответствующее рассматриваемому дисплею.

Прокрутите вниз и установите флажок рядом с , чтобы сделать это моим основным дисплеем.

Теперь, когда вы играете, у вас будет четкое изображение на экране без слез. Простой!

Топовое оборудование для NVIDIA G-Sync

NVIDIA G-Sync работает с любой из лучших видеокарт компании, но если вы ищете отличное оборудование, чтобы получить от него максимальную отдачу, это одни из наших фаворитов.

NVIDIA GeForce RTX 3080

Обладая звездной производительностью 4K и 1440p, которая превосходит RTX 2080 и RTX 2080 Ti, новый RTX 3080 — это наш выбор в качестве лучшего графического процессора для вашего игрового ПК. Просто убедитесь, что это не излишек для ваших нужд.

- Смотрите на Амазонке

- Смотрите в Best Buy

Razer Raptor 27

Razer создал идеальный дисплей как для работы, так и для игр, позволяя вам делать больше в рабочее время и при этом получать небольшое время простоя.Этот массивный великолепный экран также поддерживает G-Sync для четкой игры без разрывов.

600 долларов от RazerМы можем получать комиссию за покупки, используя наши ссылки. Учить больше.

Технология Nvidia G-SYNC VRR | PCMonitors.info

Автор: Адам Симмонс

Последнее обновление: 27 мая 2021 года

Введение

Традиционно мониторы работают с фиксированной частотой обновления — обычно 60 Гц, 120 Гц или 144 Гц. При запуске графически насыщенного контента, такого как игры, можно ожидать, что частота кадров будет колебаться в ответ на меняющиеся уровни «спроса» со стороны игры или приложения.Это ставит перед геймерами некую дилемму. Они вынуждены выбирать один из двух основных вариантов, которые определяют, как графический процессор обрабатывает «передачу кадров» на монитор — «VSync выключен» или «VSync включен». В этой статье AnandTech есть отличное подробное техническое объяснение этих двух режимов и того, что они включают, используя монитор 60 Гц в их примере.

На самом базовом уровне «VSync off» позволяет графическому процессору отправлять кадры на монитор, как только они были обработаны, независимо от того, завершил ли монитор свое обновление и готов ли он перейти к следующему кадру.Это отсутствие синхронизации в сочетании с характером обновления монитора (обычно сверху вниз) заставляет монитор отображать разные кадры по направлению к верхней части экрана по сравнению с нижней частью. Это приводит к отчетливому «разрыву» на мониторе, который действительно беспокоит некоторых пользователей. Даже на мониторе с частотой 120 Гц или 144 Гц, где некоторые пользователи неверно заявляют, что разрывов нет, они все равно остаются. Как правило, это менее заметно, но определенно остается. Даже если пользователи не замечают отчетливого разрыва, эффект этого разрыва (смещение текстуры и «дрожание») часто более очевиден.Поскольку только часть экрана отображает самую последнюю информацию, это также можно рассматривать как источник визуальной задержки .

Решением этого разрыва является опция «VSync on» , которая по существу заставляет графический процессор удерживать кадр до тех пор, пока монитор не будет готов его отобразить, поскольку он завершил отображение предыдущего кадра. Он также фиксирует частоту кадров на максимальном уровне, равном частоте обновления монитора. Хотя это устраняет разрывы, это также увеличивает входную задержку , поскольку существует внутренняя задержка перед отправкой кадров на монитор.На мониторе с частотой 120 Гц задержка ввода вдвое меньше, чем на мониторе с частотой 60 Гц, а на мониторе с частотой 144 Гц даже ниже. Тем не менее, он все еще существует, и некоторые пользователи считают, что он несколько отключает их от игрового процесса. Когда частота кадров падает ниже частоты обновления монитора, ощущение отключения увеличивается до уровня, который будет беспокоить большое количество пользователей. Некоторые кадры будут обрабатываться графическим процессором медленнее, чем монитор может их отобразить. Другими словами, монитор готов перейти к новому кадру до того, как графический процессор будет готов его отправить.Таким образом, вместо отображения нового кадра монитор снова отображает предыдущий кадр, что приводит к заиканию . Это заикание наиболее заметно, когда «тройная буферизация» отключена, поскольку частота кадров внезапно упадет до половины исходного значения, а не просто снизится на несколько кадров в секунду. Однако это все еще очень заметно для некоторых людей даже при включенной «тройной буферизации».

Nvidia G-SYNC — решение с переменной частотой кадров

Nvidia предложила решение этой проблемы; G-SYNC.Путем интеграции некоторой умной электроники (см. Ниже) в определенные мониторы можно заставить монитор принимать переменную частоту обновления (VRR), настраиваясь в реальном времени в соответствии с частотой кадров игры. Частота кадров монитора по-прежнему ограничена так же, как и без G-SYNC, но он динамически настраивается на частоту обновления до 30 Гц (текущие модели), чтобы соответствовать частоте кадров игры. Благодаря этому частота обновления монитора идеально синхронизируется с графическим процессором. Вы не получите разрывов экрана или «визуальной задержки» при отключении VSync, а также при использовании VSync вы не получите заикания или задержки ввода.

G-SYNC предназначен для использования только через DisplayPort, поскольку он полагается на свои возможности пакетов данных. Новые итерации технологии позволяют использовать отдельные устройства масштабирования для использования HDMI и блокировать меньше возможностей и функций экранного меню, чем предыдущие версии технологии. Для использования G-SYNC вам потребуется совместимый монитор и графический процессор. На стороне графического процессора, это любой графический процессор Nvidia с GeForce GTX 650 Ti Boost или «выше» — это запатентованная технология Nvidia, которая несовместима с графическими процессорами AMD.На стороне монитора был набор для модификации DIY для использования с ASUS VG248QE, который на январь 2014 года был доступен по цене около 175 долларов США. Очевидно, установка была простой 20-30-минутной работой с использованием отвертки Phillips. Модифицированные VG248QE со встроенной в них технологией были доступны в некоторых розничных магазинах по рекомендованной розничной цене 399 долларов. Этот комплект был доступен только в течение ограниченного времени, и многие модели теперь предлагают технологию, интегрированную в него напрямую.

Как G-SYNC влияет на максимальную частоту обновления монитора?

Одним из достоинств этой технологии VRR является низкая задержка по сравнению с использованием VSync.Используя то, что Nvidia называет «резервным буфером», он добавляет очень небольшую задержку по сравнению с «VSync off» (возможно, 1-2 мс). Существует некоторая путаница в отношении того, что происходит, когда монитор достигает верхнего предела своей работы с активным G-SYNC — например, 144 кадра в секунду при 144 Гц. Если у вас отключена VSync, частота кадров может быть выше частоты обновления дисплея — G-SYNC отключается, и происходит разрыв. Если у вас включен VSync и вы наблюдаете за счетчиком частоты кадров в игре или такой утилитой, как FRAPS, вы можете увидеть, что частота кадров имеет тенденцию колебаться в районе 141–143 кадров в секунду, а не постоянно на уровне 144 кадров в секунду.Тем не мение; Бывший директор по техническому маркетингу Nvidia Том Петерсен заявил в ряде видеороликов (например, здесь), что при достижении этого потолка мониторы G-SYNC ведут себя как обычные мониторы с использованием VSync. Игра выстраивает кадры в очередь, что приводит к задержке, аналогичной VSync. В любом случае взаимодействие с игровым миром показалось нам очень гладким на моделях G-SYNC, которые мы тестировали даже при этом потолке — просто помните о возможности дополнительной задержки здесь, если вы один из тех людей, которые клянусь VSync выключен для минимальной задержки.По этой причине некоторые советуют оставить VSync выключенным и вместо этого использовать ограничение частоты кадров на несколько кадров ниже потолка (например, 141 кадр / с для монитора 144 Гц), чтобы G-SYNC всегда был активен, но VSync не запускался.

Как G-SYNC действует ниже минимальной частоты обновления монитора?

При первом выпуске была минимальная частота работы 30 Гц, ниже которой монитор будет придерживаться кратной частоты обновления. Это по существу устраняет заикание и разрывы с такой же эффективностью, как и в случае с точной частотой обновления = частота кадров.Поэтому, если игра работала со скоростью 20 кадров в секунду, монитор установил бы 40 Гц, чтобы избежать заикания или разрывов, вместо того, чтобы оставаться на 30 Гц или максимальной статической частоте обновления. Сейчас Nvidia рекламирует минимальную частоту работы «1 Гц», и, по нашему опыту, технология безупречно работает в заявленном диапазоне. Однако, как мы выясняем в обзорах, где используется эта технология, низкая частота кадров — это низкая частота кадров независимо от технологии. И воспринимаемое размытие значительно выше, а общее «ощущение связности» значительно хуже при низкой частоте кадров по сравнению со значительно более высокой.

Как партнер Amazon, я зарабатываю на соответствующих покупках, совершаемых по приведенной ниже ссылке. По возможности вы будете перенаправлены в ближайший магазин. Дополнительная информация о поддержке нашей работы.

А как насчет размытия в движении?

Хотя G-SYNC может обеспечить более плавное восприятие изображения, устраняя разрыв, уменьшая заикание и уменьшая задержку, он не влияет на размытость изображения, вызванную движением наших собственных глаз или пиксельными откликами монитора.Многие геймеры очень рады альтернативной технологии, которая заполняет этот пробел, LightBoost, и, в частности, уменьшению размытости движения, которое ее принудительная активация может привести к просмотру в 2D, а не в 3D. На вопрос, можно ли использовать эту технологию вместе с LightBoost и, в частности, с принудительной активацией 2D, Эндрю Бернс из Nvidia ответил:

«У нас есть превосходный режим с низким постоянством, который должен превосходить эту неофициальную реализацию, и, что важно, он будет доступен на каждом мониторе G-SYNC.Подробности будут доступны позже ». .

Эта функция называется ULMB (Ultra Low Motion Blur), и ее можно активировать на большинстве этих новых мониторов «G-d up». Однако важно отметить, что в настоящее время его нельзя активировать одновременно с G-SYNC. Стоит помнить, что основной рабочий режим допускает переменную частоту кадров, тогда как ULMB обеспечивает фиксированную частоту кадров на верхнем уровне поддерживаемой частоты обновления монитора. Это пример технологии стробоскопической подсветки.

Мониторы, совместимые с G-SYNC

С января 2019 года Nvidia расширила поддержку VRR для серии GTX10 и новых графических процессоров, таких как серии RTX20 и RTX30. Теперь Nvidia оценивает мониторы с поддержкой Adaptive-Sync (традиционно продаваемые как «FreeSync») и позволяет их совместимым графическим процессорам использовать технологию VRR при подключении к таким мониторам. Мониторы, прошедшие сертификацию Nvidia на использование Adaptive-Sync таким образом, помечаются как «совместимые с G-SYNC». Пример такого монитора и то, как это отображается в графическом драйвере, показан в примере ниже.В данном случае Gigabyte AORUS FI27Q-X. Вам просто нужно убедиться, что установлены соответствующие флажки, как показано на изображении.

Можно использовать «G-SYNC Compatible Mode» на мониторах Adaptive-Sync, которые не сертифицированы таким образом. Nvidia не дает никаких гарантий, что технология будет работать правильно; Мы проверяем производительность G-SYNC всех моделей — сертифицированных или нет — в наших обзорах. На изображении ниже показано, как работает несертифицированный монитор, в данном случае ViewSonic XG270QC.Обратите внимание, что в нем указано: «Выбранный дисплей не подтвержден как совместимый с G-SYNC». В этом случае, когда мы тестировали, технология работала некорректно. Тем не мение; у нас часто возникали проблемы с использованием «режима совместимости с G-SYNC» на GTX 1080 Ti, использованной для этого обзора. Судя по отзывам пользователей и тому, что мы видели с нашим RTX 3090, новые графические процессоры действительно лучше справляются с этой технологией и с меньшей вероятностью будут испытывать очевидные проблемы, такие как гашение экрана или значительное широко распространенное мерцание. И мы протестировали такие модели, как BenQ EX2710 с RTX 3090, где эта технология работала не хуже FreeSync или даже лучше.«Режим совместимости с G-SYNC» также можно использовать через HDMI 2.1, используя встроенную функцию VRR порта.

В отличие от мониторов, перечисленных ниже, которые включают модуль G-SYNC, простая поддержка технологии через Adaptive-Sync не совсем то же самое. Без модуля будет меньше ограничений в отношении таких вещей, как настройки экранного меню, порты, резервная пропускная способность (которую съедает функциональность модуля) и требования к охлаждению. И они, как правило, получают более низкую цену. Но решение «Full Fat» с модулем G-SYNC обеспечивает очень тонкую настройку — с очень тщательной регулировкой напряжения.Это включает в себя переменную перегрузку, которая динамически перенастраивается при изменении частоты обновления, сводя к минимуму перерегулирование от чрезмерно агрессивной перегрузки и отставание от значительно более слабой, чем оптимальная перегрузка. Некоторые модели Adaptive-Sync реализуют это, но не так хорошо настраиваются. Модуль также обеспечивает непрерывную работу во всем диапазоне VRR, без определенной границы, в которой LFC (компенсация низкой частоты кадров) срабатывает или деактивируется, вызывая заикание и возможное мерцание, когда это происходит.Более жесткий контроль напряжения также может снизить вероятность мерцания при значительных колебаниях частоты обновления, к чему особенно склонны модели VA. Несмотря на то, что их сложно количественно оценить и изолировать, мы также столкнулись с сокращением таких проблем, как микропеременные задержки при использовании модуля.

G-SYNC Ultimate

Также была разработана новая версия G-SYNC, которая сочетает в себе элемент VRR с поддержкой технологии HDR (High Dynamic Range). Метко названный G-SYNC HDR (теперь называемый G-SYNC Ultimate) предлагает поддержку HDR10 через DisplayPort 1.4, стандарт HDR, общий для ряда игр и фильмов. Это требует гораздо большей контрастности и более широкой цветовой гаммы, чем у типичных ЖК-дисплеев, в дополнение к повышенной битовой глубине (10 бит на подпиксель). Для достижения превосходной контрастности мониторы уровня VESA DisplayHDR 1000, поддерживающие G-SYNC HDR, используют подсветку FALD (полное локальное затемнение) с 384 или более зонами затемнения. Подсветка тщательно контролируется для каждой из этих зон индивидуально, что означает, что светлые и темные элементы изображения могут одновременно получать соответствующий уровень яркости.Как и все технологии, связанные с G-SYNC, система разработана с учетом минимальной задержки и в этом отношении сильно отличается от традиционных систем FALD, которые можно увидеть на некоторых телевизорах. Кроме того, зоны можно увеличить до гораздо большей яркости, чем при традиционной подсветке (1000 кд / м² +). В некоторых моделях G-SYNC Ultimate с поддержкой VESA DisplayHDR 600 используются более простые, но все же жестко контролируемые решения для локального затемнения с малой задержкой. Между тем, расширенная цветовая гамма может быть достигнута с помощью усовершенствованных технологий задней подсветки, таких как квантовые точки и улучшенные люминофоры.В краткосрочной перспективе целью является DCI-P3, а в долгосрочной перспективе — Рек. 2020.

Подтвержденные мониторы G-SYNC Ultimate

Это список подтвержденных в настоящее время мониторов, которые имеют или будут иметь интегрированную в них «Ultimate» версию технологии:

Acer CG437KP (65 ″ BFGD ‘UHD, 120 Гц)

Acer CP7271K (27 ″ UHD, 144 Гц IPS)

Acer X27 (27 ″ UHD, 144 Гц IPS)

Acer X32 (32 ″ UHD, 144 Гц IPS)

Acer X35 ( 35 ″ 3440 × 1440, 200 Гц VA)

Acer X38 S (37.5 ″ 3840 × 1600, 175 Гц Nano IPS)

AOC AG274QG (27 ″ WQHD, 240 Гц IPS)

AOC AG353UCG (35 ″, 3440 × 1440, 200 Гц VA)

ASUS PG27UQ (27 ″ UHD, 144 Гц IPS)

ASUS PG32UQX ( 32 ″ UHD, 144 Гц IPS)

ASUS PG35VQ (35 ″ 3440 × 1440, 200 Гц VA)

ASUS PG65 (65 ″ BFGD ‘UHD, 120 Гц)

Dell Alienware AW2721D (27 ″ WQHD, 240 Гц Nano IPS)

Dell Alienware AW3821DW (37,5 ″ 3840 × 1600, 144 Гц Nano IPS)

HP OMEN X Emperium 65 (65 ″ ‘BFGD’ UHD, 120 Гц)

LG 34GP950G (34 ″ 3440 × 1440, 180 Гц Nano IPS)

MSI MEG381CQR (37.5 ″ 3840 × 1600, 175 Гц IPS)

ViewSonic XG321UG (32 ″ UHD, 144 Гц IPS)

Подтвержденные мониторы G-SYNC

Это список подтвержденных в настоящее время мониторов, которые имеют или будут иметь интегрированную в них стандартную версию технологии:

Acer X25 (24,5 ″ FHD, 360 Гц IPS)

Acer X28 (28 ″ UHD, 155 Гц IPS)

Acer X34 (34 ″ 3440 × 1440, 100 Гц IPS)

Acer X34 P (34 ″ 3440 × 1440, 120 Гц IPS)

Acer X34 S (34 ″ 3440 × 1440, 200 Гц, IPS)

Acer X38 P (37.5 ″ 3840 × 1600, 175 Гц IPS)

Acer XB240HA (24 ″ FHD, 144 Гц TN)

Acer XB241H (24 ″ FHD, 144 Гц TN)

Acer XB241YU (23,8 ″ WQHD, 144 Гц TN)

Acer XB251HQT (24,5 ″ FHD 240 Гц TN)

Acer XB252Q (24,5 ″ FHD, 240 Гц TN)

Acer XB270HA (27 ″ FHD, 144 Гц TN)

Acer XB270HU (27 ″ WQHD, 144 Гц IPS)

Acer XB271HK (27 ″ UHD, 60 Гц Acer IPS)

(27 ″ WQHD, 144 Гц IPS)

Acer XB271HUA (27 ″ WQHD, 144 Гц TN)

Acer XB271HUT (27 ″ WQHD, 144 Гц IPS)

Acer XB272 (27 ″ FHD, 240 Гц TN)

Acer XB273K (P) (27 ″ UHD, 144 Гц IPS)

Acer XB273U NX (27 ″ WQHD, 275 Гц IPS)

Acer XB273 X (27 ″ FHD, 240 Гц IPS)

Acer XB280HK (28 ″ UHD, 60 Гц TN)

Acer XB281HK (28 ″ UHD, 60 ″ UHD )

Acer XB321HK (32 ″ UHD, 60 Гц IPS)

Acer XN253QP (24.5 ″ FHD, 144 Гц TN)

Acer XN253QX (24,5 ″ FHD, 240 Гц TN)

Acer Z271 (27 ″ FHD, 144 Гц VA)

Acer Z271T (27 ″ FHD, 144 Гц VA)

Acer Z271UV (27 ″ WQHD, 165 Гц VA )

Acer Z301CT (30 ″ 2560 × 1080, 200 Гц ВА)

Acer Z321QU (31,5 ″ WQHD, 165 Гц ВА)

Acer Z35 (35 ″ 2560 × 1080, 200 Гц ВА)

Acer Z35P (35 ″ 3440 × 1440, 120 Гц ВА )

AOC g2460Pg (24 дюйма FHD, 144 Гц TN)

AOC AG241QG (23,8 дюйма WQHD, 165 Гц TN)

AOC AG251FG (24,5 дюйма FHD, 240 Гц TN)

AOC AG254FG (24,5 дюйма Full HD, 360 Гц IPS)

AOC (AG27 27 ″ WQHD, 165 Гц IPS)

AOC AG273QCG (27 ″ WQHD, 165 Гц TN)

AOC AG322QCG (31.5 ″ WQHD, 165 Гц VA)

AOC AG352UCG (35 ″ 3440 × 1440, 100 Гц VA)

ASUS PG248Q (24 ″ FHD, 180 Гц TN)

ASUS PG258Q (24,5 ″ FHD, 240 Гц TN)

ASUS PG259QN (24,5 ″ FHD, 360 Гц IPS)

ASUS PG278Q (R) (27 ″ WQHD, 144 Гц TN)

ASUS PG279Q (27 ″ WQHD, 165 Гц IPS)

ASUS PG279QE (27 ″ WQHD, 165 Гц IPS)

ASUS PG279QM (27 ″ WQHD, 240 Гц IPS)

ASUS PG279QR (27 ″ WQHD, 165 Гц IPS)

ASUS PG279QZ (27 ″ WQHD, 165 Гц IPS)

ASUS PG27AQ (27 ″ UHD, 60 Гц IPS)

ASUS PG27VQ (27 ″ WQHD, 165 Гц TN)

ASUS PG348Q (34 ″ 3440 × 1440, 100 Гц IPS)

ASUS PG349Q (34 ″ 3440 × 1440, 100 Гц IPS)

ASUS VG248QE G-SYNC (24 ″ FHD, 144 Гц)

BenQ XL2420G (24 ″ FHD, 144 Гц TN)

Dell Alienware AW2518H (24 .5 ″ FHD, 240 Гц TN)

Dell Alienware AW2521H (24,5 ″ FHD, 360 Гц IPS)

Dell Alienware AW3418DW (34 ″ 3440 × 1440, 120 Гц IPS)

Dell Alienware AW3418HW (34 ″ 2560 × 1080, 160 Гц IPS)

Dell Alienware AW3420DW (34 ″ 3440 × 1440, 120 Гц IPS)

Dell S2417DG (23,8 ″ WQHD, 165 Гц TN)

Dell S2716DG (27 ″ WQHD, 144 Гц TN)

HP Omen 27 (27 ″ WQHD, 165 Гц TN)

HP Omen X 35 (35 ″ 3440 × 1440, 100 Гц VA)

Lenovo Y25g-30 (24,5 ″ FHD, 360 Гц IPS)

Lenovo Y27g (27 ″ FHD, 144 Гц VA)

LG 32GK650G (31.5 ″ WQHD, 165 Гц VA)

LG 32GK850G (31,5 ″ WQHD, 165 Гц VA)

LG 34GK950G (34 ″ 3440 × 1440, 120 Гц Nano IPS)

LG 34UC89G (34 ″ 2560 × 1080, 166 Гц IPS)

LG 38GL950G (37,5 ″ 3840 × 1600, 175 Гц Nano IPS)

MSI NXG251R (24,5 ″ FHD, 240 Гц TN)

MSI NXG252R (24,5 ″ FHD, 240 Гц TN)

MSI NXG253R (24,5 ″ FHD, 360 Гц IPS)

Philips FHD, 272G5DYEB (272G5DYEB) 144 Гц TN)

ViewSonic XG2560 (24,5 дюйма FHD, 240 Гц TN)

ViewSonic XG270QG (27 дюймов WQHD, 165 Гц IPS)

ViewSonic XG2703-GS (27 дюймов WQHD, 165 Гц IPS)

ViewSonic XG271QG (27 дюймов WQG) ViewSonic XG2760 (27 ″ WQHD, 165 Гц TN)

Как партнер Amazon, я зарабатываю на соответствующих покупках, совершаемых по приведенной ниже ссылке.По возможности вы будете перенаправлены в ближайший магазин. Дополнительная информация о поддержке нашей работы.

Acer добавляет три HDR-монитора Predator Gaming HDR

Predator CG437K S — это массивный 42,5-дюймовый игровой монитор, совместимый с NVIDIA G-SYNC, с дисплеем UHD (3840×2160), который стремится предоставить игрокам максимально гибкий опыт, содержащий пару HDMI 2.1, которые поддерживают новейшие игровые консоли и позволяют использовать 4K 144 Гц с VRR, используя только один кабель.

USB-концентратор предлагает порт USB-B, пару портов USB 2.0 и USB 3.0 для поддержки множества периферийных устройств, а также порт USB Type-C (PD30W) для удобства. Кроме того, встроенный KVM-переключатель упрощает жизнь тем, кто управляет несколькими компьютерами. После того, как все пользователи настроены, частота обновления монитора 144 Гц и время отклика VRB 1 мс обеспечивают удовлетворительный игровой процесс.

Сертификация монитора VESA DisplayHDR 1000 гарантирует, что игры будут отлично выглядеть для энтузиастов, а кадры будут выглядеть реалистично для создателей контента.Великолепное локальное затемнение, пиковая яркость 1000 нит и высокий коэффициент контрастности помогают оживить все детали, а рейтинг монитора Delta E <1 и 90% охват цветовой гаммы DCI-P3 обеспечивают высокоточную цветопередачу. В довершение всего, совместимость с NVIDIA G-SYNC обеспечивает синхронизацию монитора и графического процессора, обеспечивая плавный игровой процесс без заиканий и разрывов.

Монитор, который делает заявления, Predator CG437K S оснащен световыми полосами RGB, которые можно синхронизировать с музыкой и мультимедиа.Он также оснащен рядом продуманных технологий, которые позволяют адаптировать монитор к среде каждого пользователя: Acer ColorSense регулирует температуру экрана в соответствии с окружающей средой, Acer LightSense определяет внешнее освещение и соответствующим образом регулирует настройки яркости монитора, а Acer ProxiSense автоматически будит монитор, когда рядом находятся пользователи, или затемняет его, когда их нет.

Predator X38 S

Predator X38 S — это изогнутый монитор UWQHD + (3840×1600) с разрешением 2300R, имеющий цветовую гамму DCI-P3 98%, рейтинг Delta E <2 и сертификацию VESA DisplayHDR 600 - квалификацию, позволяющую получать потрясающе реалистичные изображения.Яркие сцены мерцают, в то время как темные сохраняют насыщенные оттенки черного, благодаря которым мелкие детали и скрытые враги выделяются, даже когда они окутаны тенями. Частота обновления 175 Гц (разогнанная) и время отклика всего лишь 0,3 мс G-to-G позволяют игрокам сразу же переходить к действию, не беспокоясь о ореолах, а 37,5-дюймовый дисплей Agile-Splendor IPS обеспечивает великолепный внешний вид. , даже при широких углах обзора.

Predator Game Mode предлагает игрокам восемь предустановленных (настраиваемых) режимов отображения для соответствия различным жанрам контента, в то время как Acer LightSense и Acer ColorSense автоматически регулируют яркость экрана и цветовую температуру в зависимости от окружающей среды.NVIDIA G-SYNC Esports Mode — это предустановка дисплея, разработанная для соревновательных игр, которая обеспечивает минимально возможную задержку за счет отключения переменной подсветки и упрощает распознавание объектов в темных областях за счет увеличения уровня черного и точной настройки уровней гаммы.

Predator X38 S также включает в себя NVIDIA Reflex Latency Analyzer, революционный инструмент измерения задержки системы, который обнаруживает щелчки, исходящие от мыши, а затем измеряет время, которое требуется для полученных пикселей (т.д., вспышка дула пистолета) для изменения на экране, в то время как NVIDIA G-SYNC ULTIMATE обеспечивает плавный, динамичный игровой процесс, устраняя разрыв экрана, минимизируя заикание дисплея и сокращая задержку ввода.

Predator X28

Predator X28 — это 28-дюймовый монитор UHD (3840×2160), отличающийся тонким профилем и узкими рамками, которые придают ему освежающий чистый вид. Его дисплей Agile-Splendor IPS [3], сертифицированный VESA DisplayHDR400, предлагает частоту обновления 155 Гц (в разгоне) с временем отклика от G до G 1 мс, и все это очень плавно благодаря NVIDIA G-SYNC и G-SYNC Esports Mode.Монитор также оснащен анализатором задержки NVIDIA Reflex.

Acer LightSense, ColorSense и ProxiSense гарантируют, что монитор всегда будет выглядеть как можно лучше при любом освещении. Для более комфортного просмотра BlueLightShield Pro управляет длинами волн высокой энергии, чтобы выборочно отфильтровывать излучение синего света, сохраняя при этом точность цветопередачи Delta E <1.

Predator X28 — игровой монитор, сертифицированный TÜV Rheinland Eyesafe.

Цена и доступность

Predator CG437K S будет доступен в Северной Америке в ноябре по цене от 1799 долларов США.99; в странах Европы, Ближнего Востока и Африки в ноябре от 1599 евро; и в Китае в октябре по цене от 9 999 юаней.

Predator X38 S будет доступен в Северной Америке в сентябре по цене от 1999,99 долларов США; в странах Европы, Ближнего Востока и Африки в сентябре от 2199 евро; и в Китае в августе от 14 999 9000 юаней3.

ACER добавляет 27-дюймовый игровой ЖК-монитор XV270Pbmiiprfx FreeSync Premium с разрешением 0,5 мс — 20.01.2021 08:54

И, конечно же, это все еще экран Full HD.Дисплей совместим с FreeSync Premium со скоростью отклика 0,5 мс и соответствует их серии Nitro ….

ACER добавляет серию Veriton N, ПК объемом от 1 до 3 литров — 28.05.2020 08:42

Acer выпускает серию тонких настольных ПК Veriton N, предназначенных для корпоративного сегмента рынка. Они предлагают линейку из 5 моделей, которые используют корпус от 1 до 3 литров, вы можете выбрать оптимальные технические характеристики …

Apacer добавляет в линейку BLADE FIRE DDR4-3200MHz 64GB памяти — 09.01.2018 15:16

Apacer рада анонсировать BLADE FIRE DDR4 со светодиодным индикатором пульса, идеально подходящим для игр, разгона и M.Энтузиасты О. Забавно видеть скорость на 3200 МГц при мигании светодиода со скоростью 77 ударов в минуту …

ACER добавляет новый монитор ProDesigner BM320 4K — 08.05.2017 07:51

Acer представила новый 4K-монитор для процессоров ProDesigner BM320. Монитор обеспечивает точную цветопередачу благодаря поддержке 100 процентов цветовых пространств Adobe RGB и sRGB. Он & а …

Acer добавляет монитор 2560×1440 IPS BE270U — 14.11.2016 10:27

Компания Acer добавила в свою линейку новый монитор WQHD.BE270U — это 27-дюймовый экран WQHD, который будет очень популярным среди геймеров разрешением 2560×1440 в сочетании с панелью IPS. …

Acer соблазняет геймеров 4K с помощью массивного монитора HDMI 2.1 и режима G-Sync ESports

Acer Predator CG437K S (Изображение предоставлено Acer)Acer расширяет свою линейку Predator из лучших игровых мониторов с некоторыми экстремальными характеристиками, которые должны понравиться как консольным, так и ПК-геймерам, которые наслаждаются лучшими вещами в жизни.Сегодня компания анонсировала три грядущих игровых дисплея 4K , включая 42,5-дюймовую модель с HDMI 2.1 и 37,5-дюймовую модель с режимом Nvidia G-Sync ESports, который изначально был выпущен для мониторов с частотой 360 Гц.

Acer Predator CG437K S